Diferenças entre edições de "Regressão linear"

(Teste) |

|||

| (3 edições intermédias não estão a ser mostradas.) | |||

| Linha 1: | Linha 1: | ||

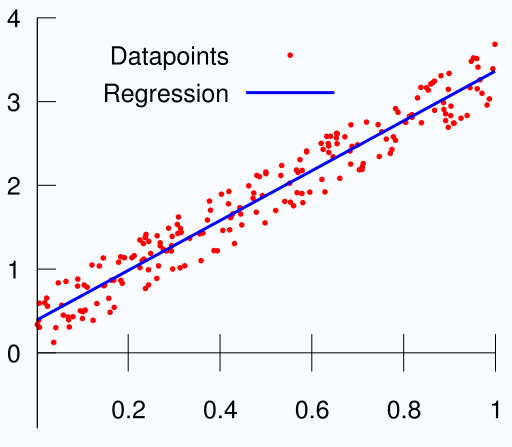

| + | [[Image:LinearRegression.png|thumb|200px|Exemplo de regressão linear.]] | ||

Em [[Estatística|estatística]], '''regressão linear''' é um método para se estimar a condicional (valor esperado) de uma variável ''y'', dados os valores de algumas outras variáveis ''x''. | Em [[Estatística|estatística]], '''regressão linear''' é um método para se estimar a condicional (valor esperado) de uma variável ''y'', dados os valores de algumas outras variáveis ''x''. | ||

| Linha 6: | Linha 7: | ||

== Equação da Regressão Linear== | == Equação da Regressão Linear== | ||

| − | |||

Para se estimar o valor esperado, usa-se de uma equação, que determina a relação entre ambas as variáveis. | Para se estimar o valor esperado, usa-se de uma equação, que determina a relação entre ambas as variáveis. | ||

| Linha 14: | Linha 14: | ||

Em que: | Em que: | ||

| + | |||

<tex>Y_i</tex> - Variável explicada (dependente); é o valor que se quer atingir; | <tex>Y_i</tex> - Variável explicada (dependente); é o valor que se quer atingir; | ||

| − | <tex>\alpha</tex> - É uma constante, que representa a intercepção da | + | <tex>\alpha</tex> - É uma constante, que representa a intercepção da recta com o eixo vertical; |

<tex>\beta</tex> - É outra constante, que representa o declive da recta; | <tex>\beta</tex> - É outra constante, que representa o declive da recta; | ||

| Linha 25: | Linha 26: | ||

===Cálculo dos factores <tex>\alpha</tex> e <tex>\beta</tex>=== | ===Cálculo dos factores <tex>\alpha</tex> e <tex>\beta</tex>=== | ||

| − | |||

:<tex>\hat{\alpha}=\frac{\sum \,X^2 \sum Y -\sum \,(X Y) \, \sum X}{n \, \sum_\,X^2-(\sum X)^2}</tex> | :<tex>\hat{\alpha}=\frac{\sum \,X^2 \sum Y -\sum \,(X Y) \, \sum X}{n \, \sum_\,X^2-(\sum X)^2}</tex> | ||

| Linha 38: | Linha 38: | ||

:<tex>\hat{\alpha}=\overline{Y}-\hat{\beta} \, \overline{X}</tex> | :<tex>\hat{\alpha}=\overline{Y}-\hat{\beta} \, \overline{X}</tex> | ||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| + | ==== Desenvolvimento ==== | ||

O objectivo é determinar <tex>\alpha</tex> e <tex>\beta</tex> de forma que a soma dos quadrados dos erros seja mínima, ou seja, devemos minimizar | O objectivo é determinar <tex>\alpha</tex> e <tex>\beta</tex> de forma que a soma dos quadrados dos erros seja mínima, ou seja, devemos minimizar | ||

| + | |||

:<tex>\sum (Y_i \, - \, \beta \, X_i \, - \, \alpha)^2</tex> | :<tex>\sum (Y_i \, - \, \beta \, X_i \, - \, \alpha)^2</tex> | ||

| + | |||

Desenvolvendo este quadrado e eliminando os termos constantes (ou seja, aqueles que não têm termos em <tex>\alpha</tex> e <tex>\beta</tex>, chega-se a: | Desenvolvendo este quadrado e eliminando os termos constantes (ou seja, aqueles que não têm termos em <tex>\alpha</tex> e <tex>\beta</tex>, chega-se a: | ||

| + | |||

:<tex>\beta^2 \, \sum X^2 \, + \, n \, \alpha^2 \, - \, 2 \, \beta \sum (X Y) \, - \, 2 \, \alpha \, \sum Y \, + \, 2 \, \alpha \, \beta \, \sum X</tex> | :<tex>\beta^2 \, \sum X^2 \, + \, n \, \alpha^2 \, - \, 2 \, \beta \sum (X Y) \, - \, 2 \, \alpha \, \sum Y \, + \, 2 \, \alpha \, \beta \, \sum X</tex> | ||

| + | |||

A partir desse ponto, pode-se resolver usando-se cálculo (tomando as derivadas parciais, etc), ou através de uma transformação de coordenadas: | A partir desse ponto, pode-se resolver usando-se cálculo (tomando as derivadas parciais, etc), ou através de uma transformação de coordenadas: | ||

| + | |||

:<tex>\alpha \, = \, \alpha_1 \, - \, \frac { \sum X } { n } \, \beta</tex> | :<tex>\alpha \, = \, \alpha_1 \, - \, \frac { \sum X } { n } \, \beta</tex> | ||

| + | |||

ou | ou | ||

| Linha 62: | Linha 64: | ||

Transformando a expressão a ser minimizada em: | Transformando a expressão a ser minimizada em: | ||

| − | + | <tex>\beta^2 \, \sum X^2 \, + \, n \, \alpha_1^2 \, - \, 2 \, \alpha_1 \, \beta \, \sum X + \frac { (\sum X)^2 } { n } \, \beta^2 - \, 2 \, \beta \sum (X Y) \, - \, 2 \, \alpha_1 \, \sum Y \, + \, 2 \, \overline{X} \, \sum Y \, \beta \, + \, 2 \, \alpha_1 \, \beta \, \sum X \, - \, 2 \, \frac {(\sum X)^2 } { n } \, \beta^2</tex> | |

ou | ou | ||

| − | + | <tex>\beta^2 \, \sum X^2 \, + \, n \, \alpha_1^2 \, - \frac { (\sum X)^2 } { n } \, \beta^2 - \, 2 \, \beta \sum (X Y) \, - \, 2 \, \alpha_1 \, \sum Y \, + \, 2 \, \overline{X} \, \sum Y \, \beta</tex> | |

Esta expressão se separa na soma de duas expressões quadráticas independentes, que podem ser minimizadas usando matemática elementar: | Esta expressão se separa na soma de duas expressões quadráticas independentes, que podem ser minimizadas usando matemática elementar: | ||

| + | |||

:<tex>n \, \alpha_1^2 \, - \, 2 \, \alpha_1 \, \sum Y</tex> | :<tex>n \, \alpha_1^2 \, - \, 2 \, \alpha_1 \, \sum Y</tex> | ||

| + | |||

:<tex>\beta^2 \, \sum X^2 \, - \frac { (\sum X)^2 } { n } \, \beta^2 - \, 2 \, \beta \sum (X Y) \, + \, 2 \, \frac { \sum X \sum Y } { n } \, \beta</tex> | :<tex>\beta^2 \, \sum X^2 \, - \frac { (\sum X)^2 } { n } \, \beta^2 - \, 2 \, \beta \sum (X Y) \, + \, 2 \, \frac { \sum X \sum Y } { n } \, \beta</tex> | ||

| + | |||

Cujos valores minimizadores são: | Cujos valores minimizadores são: | ||

| Linha 82: | Linha 87: | ||

:<tex>\beta \, = \, \frac { n \, \sum (X Y) - \sum X \sum Y } { n \, \sum X^2 - (\sum X)^2 } </tex> | :<tex>\beta \, = \, \frac { n \, \sum (X Y) - \sum X \sum Y } { n \, \sum X^2 - (\sum X)^2 } </tex> | ||

| − | |||

| − | |||

| − | |||

| + | ==== Memorização ==== | ||

Uma forma fácil de memorizar esta expressão é escrever: | Uma forma fácil de memorizar esta expressão é escrever: | ||

| + | |||

:<tex>Y = \alpha + X \beta</tex> | :<tex>Y = \alpha + X \beta</tex> | ||

| + | |||

:<tex>XY = X \alpha + X^2 \beta</tex> | :<tex>XY = X \alpha + X^2 \beta</tex> | ||

| + | |||

e, em seguida, ''somar'' as colunas: | e, em seguida, ''somar'' as colunas: | ||

| + | |||

:<tex>\sum Y = n \alpha + \sum X \beta</tex> | :<tex>\sum Y = n \alpha + \sum X \beta</tex> | ||

| + | |||

:<tex>\sum (XY) = \sum X \alpha + \sum (X^2) \beta</tex> | :<tex>\sum (XY) = \sum X \alpha + \sum (X^2) \beta</tex> | ||

| + | |||

===Intervalos de confiança=== | ===Intervalos de confiança=== | ||

O valor estimato de <tex>\beta\,</tex>, <tex>\hat{\beta}\,</tex>, deve ser analisado através da [[distribuição t de Student]], porque | O valor estimato de <tex>\beta\,</tex>, <tex>\hat{\beta}\,</tex>, deve ser analisado através da [[distribuição t de Student]], porque | ||

| + | |||

:<tex>t = \frac {(\hat{\beta} - \beta) \ \sqrt{n - 2} \ \sqrt{\sum(X_i - \overline{X})^2}} {\sqrt{\sum \hat{\epsilon_i}^2}},</tex> | :<tex>t = \frac {(\hat{\beta} - \beta) \ \sqrt{n - 2} \ \sqrt{\sum(X_i - \overline{X})^2}} {\sqrt{\sum \hat{\epsilon_i}^2}},</tex> | ||

| + | |||

tem a distribuição t de Student com n-2 graus de liberdade (ver [http://digital.library.adelaide.edu.au/coll/special/fisher/43.pdf Fisher, R. A. (1925). "Applications of "Student's" distribution". Metron 5: 90–104.]), em que: | tem a distribuição t de Student com n-2 graus de liberdade (ver [http://digital.library.adelaide.edu.au/coll/special/fisher/43.pdf Fisher, R. A. (1925). "Applications of "Student's" distribution". Metron 5: 90–104.]), em que: | ||

| + | |||

:<tex>\hat{\epsilon_i} = Y_i - \hat{\beta} \ X_i - \hat{\alpha}\,</tex> | :<tex>\hat{\epsilon_i} = Y_i - \hat{\beta} \ X_i - \hat{\alpha}\,</tex> | ||

| + | |||

A variância de <tex>\epsilon_i\,</tex>, <tex>\sigma^2\,</tex> pode ser estimada através dos erros observados: | A variância de <tex>\epsilon_i\,</tex>, <tex>\sigma^2\,</tex> pode ser estimada através dos erros observados: | ||

| + | |||

:<tex>\chi_{n-2}^2 = \frac {\sum \hat{\epsilon_i}^2} {\sigma^2}</tex> | :<tex>\chi_{n-2}^2 = \frac {\sum \hat{\epsilon_i}^2} {\sigma^2}</tex> | ||

| + | |||

se distribui como uma [[Chi quadrado]] com n-2 graus de liberdade. | se distribui como uma [[Chi quadrado]] com n-2 graus de liberdade. | ||

==Bibliografia== | ==Bibliografia== | ||

| − | |||

*REIS, E., ''Estatistica Descritiva'' (2ª ed.). Lisboa: Edições Sílabo, 1994 | *REIS, E., ''Estatistica Descritiva'' (2ª ed.). Lisboa: Edições Sílabo, 1994 | ||

| − | + | ||

| + | |||

{{Wikipedia|Regressão_linear}} | {{Wikipedia|Regressão_linear}} | ||

[[Categoria:Estatística]] | [[Categoria:Estatística]] | ||

Edição atual desde as 12h27min de 13 de outubro de 2008

Em estatística, regressão linear é um método para se estimar a condicional (valor esperado) de uma variável y, dados os valores de algumas outras variáveis x.

Em estatística, regressão linear é um método para se estimar a condicional (valor esperado) de uma variável y, dados os valores de algumas outras variáveis x.

A regressão, em geral, trata da questão de se estimar um valor condicional esperado.

A regressão linear é chamada "linear" porque se considera que a relação da resposta às variáveis é uma função linear de alguns parâmetros. Os modelos de regressão que não são uma função linear dos parâmetros se chamam modelos de regressão não-linear.

Índice

Equação da Regressão Linear

Para se estimar o valor esperado, usa-se de uma equação, que determina a relação entre ambas as variáveis.

Em que:

- Variável explicada (dependente); é o valor que se quer atingir;

- É uma constante, que representa a intercepção da recta com o eixo vertical;

- É outra constante, que representa o declive da recta;

- Variável explicativa (independente), representa o factor explicativo na equação;

- Variável que inclui todos os factores residuais mais os possíveis erros de medição. O seu comportamento é aleatório, devido à natureza dos factores que encerra. Para que essa fórmula possa ser aplicada, os erros devem satisfazer determinadas hipóteses, que são: serem variáveis normais, com a mesma variância

(desconhecida), independentes e independentes da variável explicativa X.

Cálculo dos factores  e

e

Definindo e

, temos que

e

se relacionam por:

Desenvolvimento

O objectivo é determinar e

de forma que a soma dos quadrados dos erros seja mínima, ou seja, devemos minimizar

Desenvolvendo este quadrado e eliminando os termos constantes (ou seja, aqueles que não têm termos em e

, chega-se a:

A partir desse ponto, pode-se resolver usando-se cálculo (tomando as derivadas parciais, etc), ou através de uma transformação de coordenadas:

ou

Transformando a expressão a ser minimizada em:

ou

Esta expressão se separa na soma de duas expressões quadráticas independentes, que podem ser minimizadas usando matemática elementar:

Cujos valores minimizadores são:

Memorização

Uma forma fácil de memorizar esta expressão é escrever:

e, em seguida, somar as colunas:

Intervalos de confiança

O valor estimato de ,

, deve ser analisado através da distribuição t de Student, porque

tem a distribuição t de Student com n-2 graus de liberdade (ver Fisher, R. A. (1925). "Applications of "Student's" distribution". Metron 5: 90–104.), em que:

A variância de ,

pode ser estimada através dos erros observados:

se distribui como uma Chi quadrado com n-2 graus de liberdade.

Bibliografia

- REIS, E., Estatistica Descritiva (2ª ed.). Lisboa: Edições Sílabo, 1994

| |

Esta página usa conteúdo da Wikipedia. O artigo original estava em Regressão_linear. Tal como o Think Finance neste artigo, o texto da Wikipedia está disponível segundo a GNU Free Documentation License. |